[오픈소스] RouteLLM: 더 똑똑하고 경제적인 AI 채팅봇 만들기

#AI/LLM/오픈소스

안녕하세요, 여러분! 오늘은 AI 기술의 최전선에서 주목받고 있는 흥미로운 프로젝트인 RouteLLM에 대해 소개해 드리려고 합니다. AI 채팅봇을 만들고 계시거나, 비용 효율적인 AI 솔루션에 관심이 있으신 분들께 특히 유용한 내용이 될 것 같아요.

RouteLLM이 뭔가요?

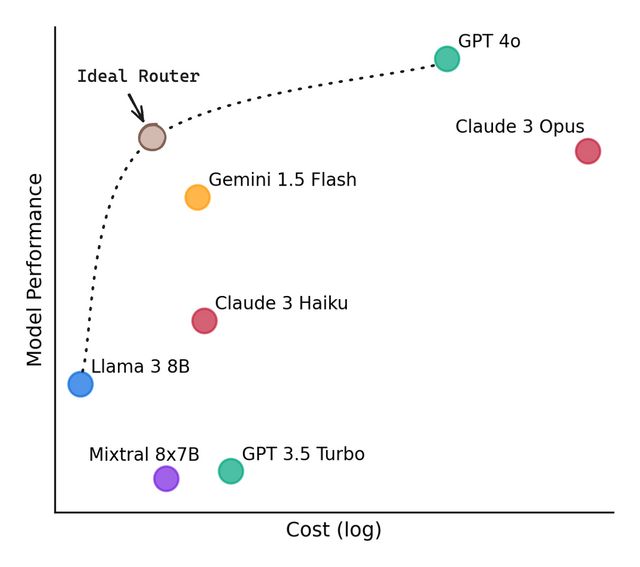

RouteLLM은 간단히 말해 "AI의 교통정리 담당자"라고 할 수 있습니다. 이 프레임워크는 사용자의 질문을 분석해서 "이 질문은 비싸지만 똑똑한 AI한테 물어볼까? 아니면 조금 덜 똑똑하지만 저렴한 AI한테 물어볼까?"를 결정합니다.

왜 이런 게 필요할까요?

비용 절감: GPT-4 같은 고급 AI 모델은 정말 뛰어나지만, 사용 비용이 만만치 않습니다. 모든 질문을 이런 고급 모델에 물어보면 비용이 폭탄이 될 수 있죠.

효율성: 간단한 질문들은 덜 복잡한 AI 모델로도 충분히 답변할 수 있습니다.

성능 유지: 중요한 건, 이렇게 비용을 줄이면서도 전반적인 답변 품질은 거의 그대로 유지할 수 있다는 거예요.

RouteLLM의 핵심 기능

OpenAI API와 호환: 기존에 OpenAI API를 사용하던 프로젝트에 쉽게 적용할 수 있어요.

사전 훈련된 라우터 제공: 연구팀에서 미리 훈련해놓은 라우터를 바로 사용할 수 있습니다. 이 라우터들은 비용을 최대 85%까지 줄이면서도 GPT-4 성능의 95%를 유지할 수 있다고 해요.

확장성: 새로운 라우터를 쉽게 추가하고 성능을 비교해볼 수 있습니다.

어떻게 사용하나요?

설치하기

pip install "routellm[serve,eval]"명령어로 쉽게 설치할 수 있어요.기본 설정

import os from routellm.controller import Controller os.environ["OPENAI_API_KEY"] = "sk-XXXXXX" os.environ["ANYSCALE_API_KEY"] = "esecret_XXXXXX" client = Controller( routers=["mf"], strong_model="gpt-4-1106-preview", weak_model="anyscale/mistralai/Mixtral-8x7B-Instruct-v0.1", )여기서 'mf'는 추천되는 라우터 모델이에요. strong_model은 고급 AI (여기선 GPT-4), weak_model은 덜 복잡한 AI (여기선 Mixtral-8x7B)를 지정합니다.

임계값 설정

python -m routellm.calibrate_threshold --routers mf --strong-model-pct 0.5 --config config.example.yaml이 명령어로 어느 정도 수준의 질문부터 고급 AI에게 물어볼지 결정합니다. 여기서는 전체 질문의 50%를 고급 AI에 물어보도록 설정했어요.

사용하기

response = client.chat.completions.create( model="router-mf-0.11593", messages=[ {"role": "user", "content": "안녕하세요!"} ] )이렇게 하면 RouteLLM이 질문을 분석해서 적절한 AI 모델에 전달합니다.

실제로 어떤 효과가 있나요?

연구팀에서 실험해본 결과, MT Bench라는 벤치마크에서 비용을 85%나 절감하면서도 GPT-4 성능의 95%를 유지할 수 있었다고 합니다. 정말 놀라운 결과죠?

마무리

RouteLLM은 AI 기술을 더 경제적이고 효율적으로 사용할 수 있게 해주는 혁신적인 도구입니다. 특히 대규모로 AI 서비스를 운영하는 기업이나, 제한된 예산으로 고품질 AI 서비스를 제공하고 싶은 스타트업에게 매우 유용할 것 같아요.

여러분도 RouteLLM을 한번 시도해보시는 건 어떨까요? AI의 힘을 더 스마트하게 활용하는 방법을 직접 경험해보세요!

[광고] STEEM 개발자 커뮤니티에 참여 하시면, 다양한 혜택을 받을 수 있습니다.